개인용 기기, 방열 더 어려워

소자·기판, 감내할 수준 돼야

[시사저널e=고명훈 기자] 지난 2분기 삼성전자 반도체와 SK하이닉스는 각각 6조4500억원과 5조4685억원의 영업이익을 기록했다. 높은 영업이익을 기록했던 배경에 고대역폭메모리(HBM)의 공도 컸다. 현재 서버용으로만 사용되는 HBM이지만 온디바이스 AI 시장 확산으로 PC와 스마트폰으로 시장을 넓힐 것이란 전망이다.

1일 반도체업계 관계자는 “HBM이 AI 가속기뿐만 아니라 향후에는 개인용 데스크탑이나 모바일에도 들어갈 것”이라며 “지금보다 가격이 내려간다면 가능한 일”이라고 말했다.

그러면서 “구체적인 HBM 스펙이나 가격은 전적으로 애플리케이션에 달린 사항이며, 그 주변 소자나 기판이 이를 감내할 수준이 돼야 할 것”이라고 덧붙였다.

HBM이 서버가 아닌 PC나 스마트폰처럼 개인용 기기 시장까지 확대되려면 가격이 낮아져야 한단 지적이다. 여기에 발열 문제를 안정적으로 관리하는 것도 관건으로 지목된다.

HBM은 여러 개의 D램을 수직으로 적층한 구조로, 일반 D램 대비 작동 속도가 적층수와 비례해 빠르기 때문에 열이 나기 쉽다.

서버용 AI 가속기에서 HBM은 GPU 바로 옆에 붙어 있어 ‘니어(near) 메모리’라고도 불리는데, 폼팩터가 작은 PC나 스마트폰에서 애플리케이션 프로세서(AP)와 더 근접해 있거나 하나의 패키지로 결합된 형태여서 열에 취약해진다.

전자부품업계 관계자는 “HBM은 일반 D램 대비 입출력(I/O) 밀도와 집적도가 높기 때문에 열이 그만큼 날 수밖에 없으며, 방열이 어려워진다”며 “메모리는 열에 취약한 특성을 갖는데 좁은 공간 안에서 로직 칩과 붙어 있으므로 열의 흐름을 잘 이해하고 제어하지 못하면 로직 칩에서 나오는 열이 HBM에 데미지를 주고 신뢰성을 해칠 수 있다”고 설명했다.

온디바이스 내 HBM 상용화가 가능하다면 관련 시장은 더 가파른 폭의 성장을 이어갈 것으로 전망된다. 시장조사업체 QY리서치에 따르면 글로벌 온디바이스 AI 반도체 시장 규모는 지난해 27억2000만달러(약 3조7332억원)에서 16.5%의 연평균 성장률로 2030년엔 81억 3000만달러(약 11조1584억원)까지 늘어날 것으로 예상된다.

미국 투자은행 골드만삭스는 보고서를 통해 글로벌 HBM 시장이 지난해부터 오는 2026년까지 연평균(CAGR) 2배씩 성장해 300억달러(약 41조원) 수준까지 오를 것으로 전망하기도 했다.

곽민정 현대차증권 연구원은 “최근 AI 반도체 시장에서 AI 연산장치와 메모리 간 물리적 거리를 좁히고 대역폭을 넓혀 데이터를 빠르게 주고받을 수 있는 특성이 강조되면서 서버에서 온디바이스까지 시장이 확대되고 있다”며 “AI 서버 내 GPU가 HBM과 데이터를 주고받으며 AI 연산을 수행하는 것처럼, 온디바이스 역시 HBM에 상응하는 메모리가 필요하다”고 분석했다.

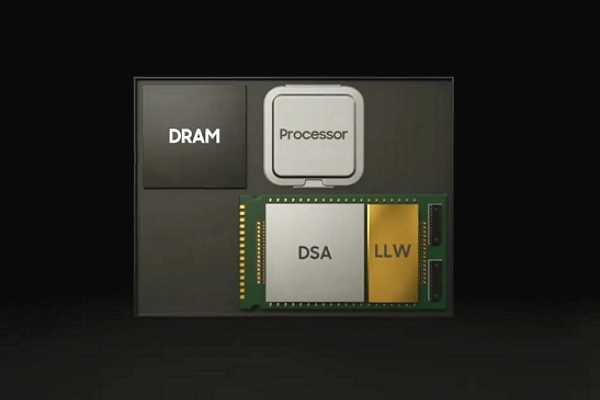

현재는 온디바이스 AI용 저전력 메모리 솔루션으로 저지연 와이드 I/O(LLW) D램이 활용된다. LLW D램은 I/O 단자를 늘려 기존 모바일 제품인 LPDDR 대비 대역폭을 높인 특수 D램으로, 단말단에서 AI 모델을 구동하는 데 적합한 솔루션으로 주목받는다.

SK하이닉스는 애플이 올해 출시한 혼합현실(MR) 디바이스 ‘비전프로’에 R1용 메모리로 LLW D램을 공급하고 있으며, 삼성전자 또한 128GB/s와 1.2pJ/b의 낮은 전력으로 구동되는 LLW D램을 개발하고 상용화를 준비 중이다.